|

|

|

| オーロラ画像1 | オーロラ画像2 |

|

|

| レーザ搭載移動ロボット(初号機) | レーザ搭載移動ロボット(2号機) |

|

|

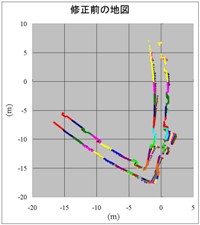

| 修正前の地図 | 修正後の地図 |

|

|

|

| 単眼初号機ロボット | 単眼2号機ロボット | ステレオ初号機ロボット |

|

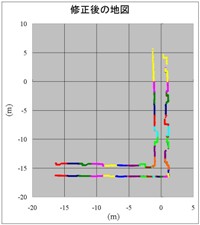

| ミミズ初号機ロボット(中央大中村太郎准教授と共同研究) |

|

|

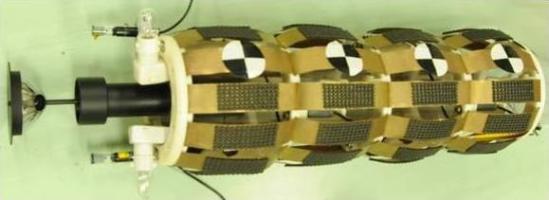

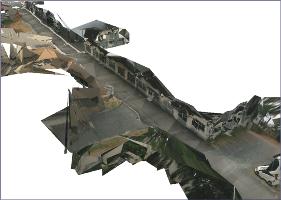

| 屋外環境計測結果 | テクスチャマッピング結果 |

|

|

| ウェアラブルビジョンシステム | タッチパネル上での誘導 |

|

|

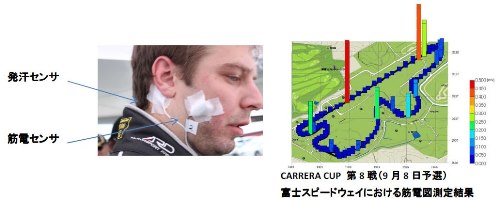

| カーレーサーの計測 (http://www.gsport.co.jp/img/pdf/press_releases20121120.pdfより抜粋) |

|

|

|

|

| 動作の計測 | 筋肉の動き | 可視化 |

|

|

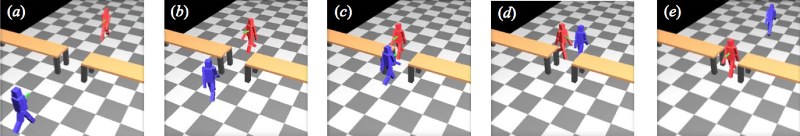

| 歩行者の行動のモデル化:狭い場所で道を譲る行動の発現 |

|

|

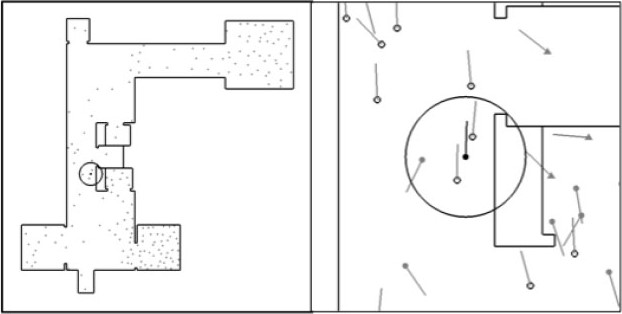

| 移動ロボットのナビゲーション 左図:ロボットが移動している様子.右図:ロボット周囲の拡大図 |

|

|

|

|

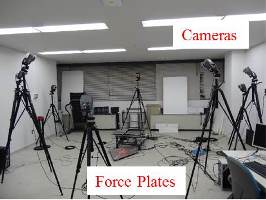

| 人間動作の計測 | 人間動作の計測装置 | 人間動作の解析シミュレーション |

|

|

| ラバーハンド錯覚 |